重磅!北大最新实证震撼学术界:AI写作全面失控,期刊政策毫无作用!

近年来,全球学术期刊纷纷推出“AI 使用政策”:

要求披露、限制使用、禁止署名、严防滥用……

一时间,看上去仿佛构筑了某种“学术写作的防火墙”。

但北大研究团队最新的大规模实证研究告诉你:

这些政策几乎没有任何作用。AI 正在以失控的速度渗透学术写作。学术界,可能真的已经被 AI 重塑得面目全非。

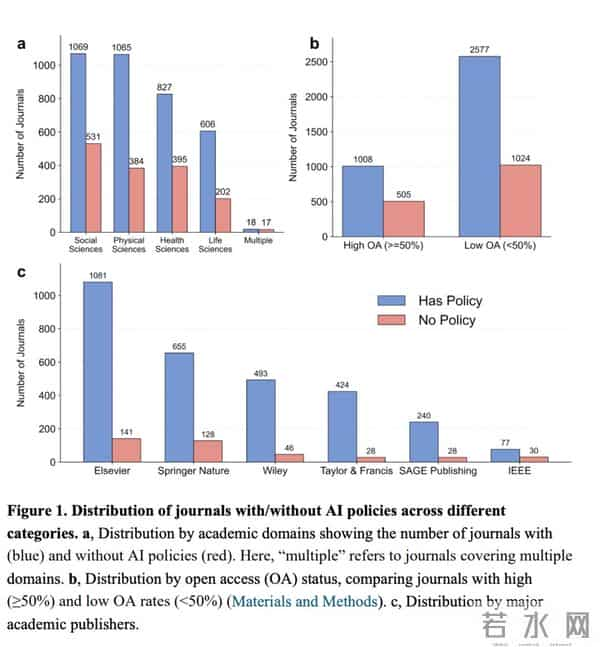

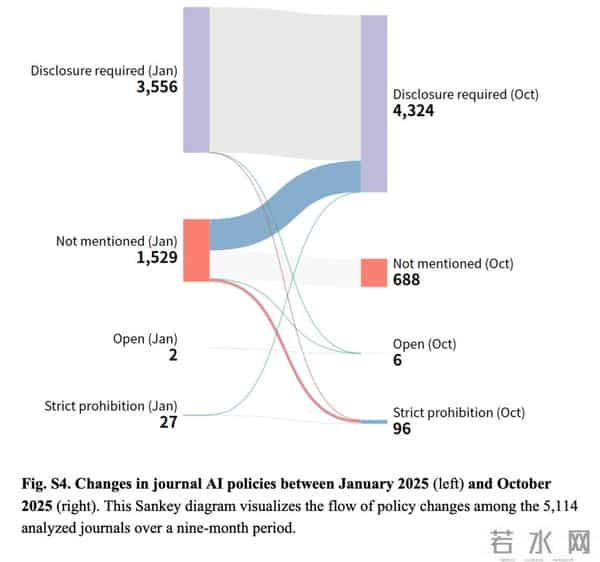

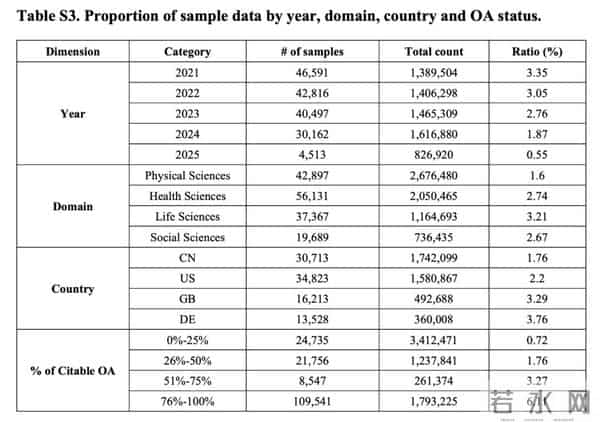

01|70% 期刊制定了 AI 政策,但它们几乎形同虚设研究者系统分析了5114 个 JCR Q1 期刊的 AI 政策,发现:

70% 明确发布了 AI 使用指南

大多数要求作者披露是否使用 AI

“严格禁止”类政策极为罕见

看起来,全球期刊已经在严肃面对 AI 写作问题。

但真正的问题是:

这些政策仅仅存在于网页上,而不是作者的写作行为中。  02 | 520 万篇论文:AI 写作自 2023 年起全面爆炸式增长

02 | 520 万篇论文:AI 写作自 2023 年起全面爆炸式增长

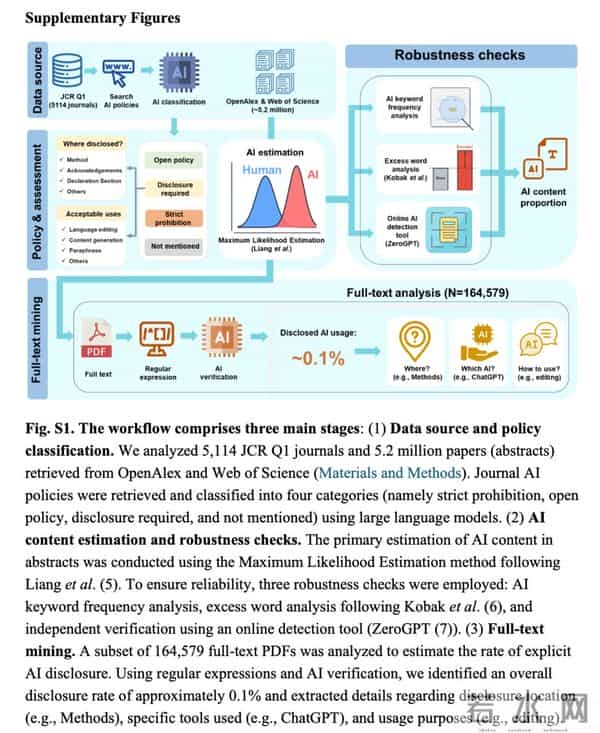

研究团队通过分析523 万篇摘要,结合 4 种 AI 痕迹检测方法,得出一个惊人的趋势:

2023 年是分水岭:AI 辅助写作使用量急剧攀升

2024–2025 更是进入“全面渗透期”

关键不是“是否使用 AI”,而是“使用得多还是非常多”

更令人不安的是:

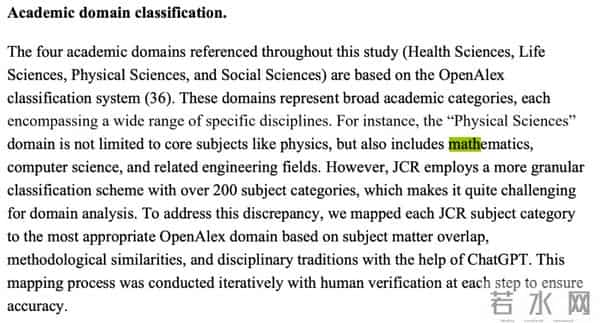

这种爆发式增长,与期刊是否有 AI 政策完全无关。有没有政策,研究者一样用,丝毫不减。

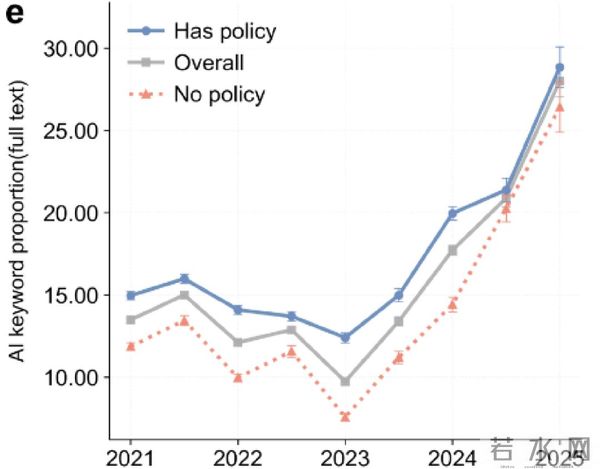

三、最让人焦虑的发现:期刊有政策 vs 没政策 → 差别为零

研究用统计检验反复确认:

有 AI 政策的期刊

没 AI 政策的期刊

两者的AI 写作增长曲线几乎完全重合。

换句话说:

政策没有任何实际效果。AI 写作的浪潮无人能挡。这意味着:

期刊的治理策略可能已经彻底滞后

作者完全不受政策影响

学术出版的“规则—执行”链条正在断裂

如果说以前的论文还能分出“AI 改没改”,那未来可能只有一个标准——

有没有人类写的部分。

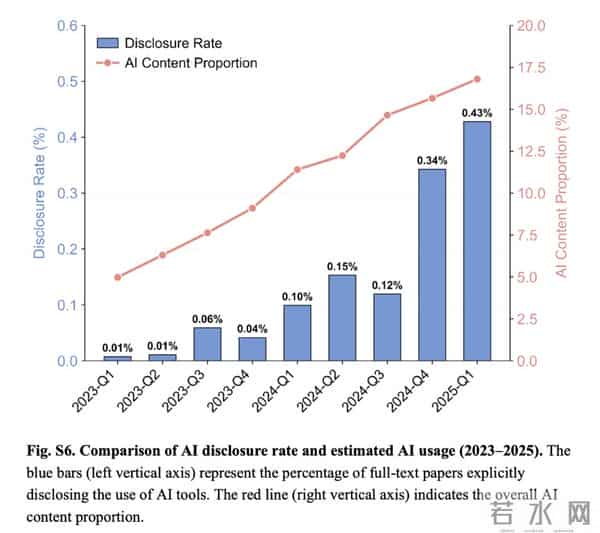

04 | 谁在最疯狂地用 AI?三类群体冲在最前面

04 | 谁在最疯狂地用 AI?三类群体冲在最前面

研究发现三大群体正在“狂奔式拥抱 AI”:

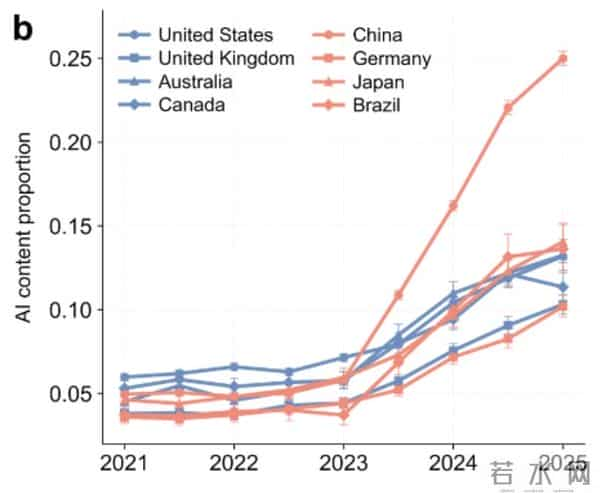

1. 非英语国家作者增长速度最快的国家:

中国 > 德国 > 日本 > 巴西

这说明 AI 正在成为全球科研写作“语言公平化”的工具,但同时也意味着:语言不再是论文质量的门槛了。

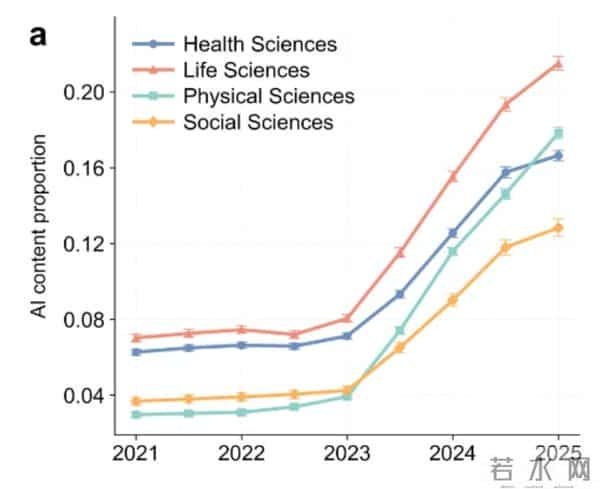

2. 物理科学类学科

2. 物理科学类学科

包含:

数学

计算机科学

工程

物理

这些领域的写作风格本来就更技术化、模板化,AI 的渗透更容易,也更猛烈。

3. 高开放获取(High-OA)期刊

3. 高开放获取(High-OA)期刊

OA 越高,AI 痕迹越高。

某些 OA 期刊可能已经悄然进入:“快速出版 + 大规模 AI 写作”的新模式。

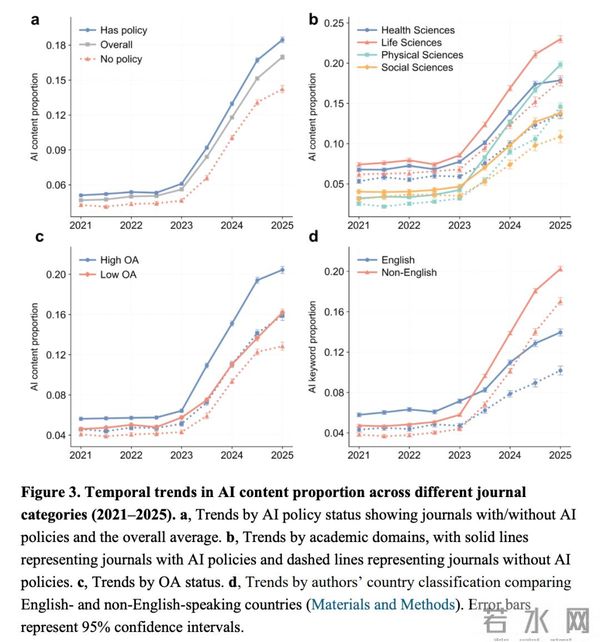

05 | 最震撼的事实:AI 使用披露率 ≈ 0%

05 | 最震撼的事实:AI 使用披露率 ≈ 0%

论文对164,579 篇全文做了深度挖掘,寻找真正的 AI 使用披露。

结果令人瞠目:

2023–2025 共75,172 篇论文中

仅 76 篇明确披露使用 AI

披露率约为0.1%

而同一时期的 AI 痕迹检测显示:

至少 40 篇论文中有 AI 使用,只有 1 篇愿意承认。披露率之低,几乎到了“不敢想象”的程度。

换句话说:

绝大多数论文都在使用 AI,但几乎没人承认。

(原因可能包括:担心拒稿、担心同行质疑、担心影响学术信用……)

06 | 学术界面对 AI 的“治理危机”正在浮现

06 | 学术界面对 AI 的“治理危机”正在浮现

五百万级别的实证数据告诉我们:

政策不生效:规定存在,但没人遵守

披露制度失败:作者普遍隐瞒 AI 使用

检测机制脆弱:技术手段跟不上 AI 发展速度

学术伦理正在被重新塑造

作者指出:当前政策关注“禁止或披露”,而非“如何正确使用”。

这就像想用“红绿灯”来管理高速奔跑的“喷气式飞机”。

07 | 这项研究的重要启示1. AI 写作已经不可逆,越早接受越有利

07 | 这项研究的重要启示1. AI 写作已经不可逆,越早接受越有利

未来的论文写作不再是“能不能用 AI”,而是“如何更高质量地用 AI”。

2. 学术政策必须升级,走向“负责任 AI”的路线否则未来可能出现:

学术不端界限模糊化

人机作者权责不清

评审体系失效

3. 全球学者的竞争格局正在被重新洗牌尤其是语言优势被削弱之后,传统科研强国也可能受到冲击。

4. 我们正站在学术出版百年变革的前夜政策失效意味着:未来的科研生态将不可避免地向AI—人类协作模式迁移。

谁先适应,谁就先占据新赛道。

结语:这是一场正在发生的“无声革命”北大的这项研究给出了一个残酷但真实的事实:

AI 正在重新定义科学写作,而现行制度完全跟不上。我们正处在一个历史性的转折点:

学术写作的本质、规则、伦理、评价体系……

都将被迫重建。

如果你是一名科研工作者、学生、教师、编辑,

那么你已经身在这场变革之中。

真正的问题不是:

AI 会不会改变学术?

而是:

你准备好了吗?

声明:本站所有文章资源内容,如无特殊说明或标注,均为采集网络资源。如若本站内容侵犯了原著者的合法权益,可联系本站删除。