大摩:中国AI算力的供给及需求

1、H200开放的监管态度与需求影响

监管层对H200采购的态度:美国放开H200供应,对比H20与H200的芯片类型差异:H20是主要针对推理需求的芯片,国产芯片已能很好满足大模型推理性能需要,放开H20对中国企业无特别大增益,反而可能妨害国产芯片发展;H200是更多针对训练使用的芯片,性能和速度领先,国内无非常好的替代品,且国内大量模型未完成从Hopper架构向Blackwell架构转变,H200有很大需求,更符合国内AI行业发展需要,因此监管层可能允许企业采购H200,但可能通过审批形式平衡模型玩家需求及国产芯片发展。

H200对中国企业的需求价值:中国AI算力芯片一直供不应求,算法优化(如最新的Deepseek V3.2)是被算力短缺倒逼出来的。腾讯在三季报时因GPU供应限制下调过CAPEX;阿里巴巴虽给出三年3000多亿CAPEX预算,但多次强调AI云供给远赶不上需求,即便三年CAPEX也可能不够。资本市场对投资中国AI的一大担忧是芯片供应或算力短缺问题。预计中国主要hyper scalers的CAPEX未来三年以25% CAGR增长至2027年的近4500亿,但仍远低于美国大厂水平。放开H200这种更短缺的训练芯片,将对云厂商(中国AI赋能者)带来正面影响,进而辐射下游模型和应用。

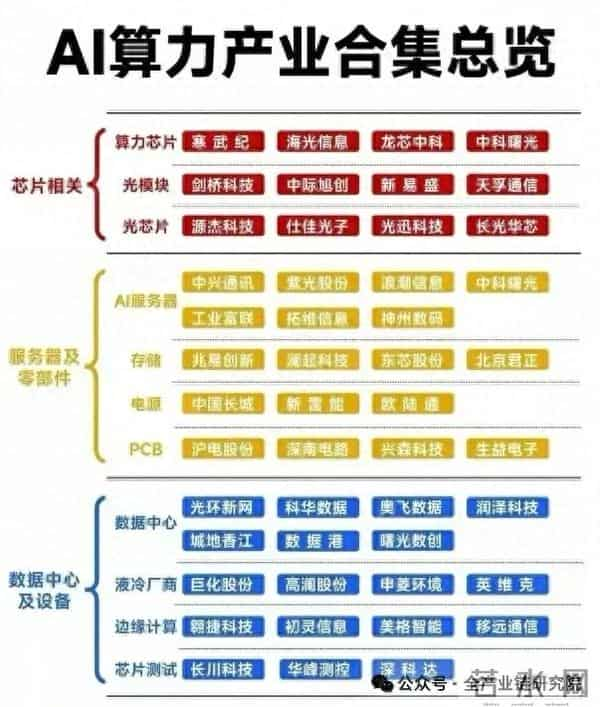

AI算力受益标的推荐:放开H200同样利好云厂商上游的数据中心玩家,数据中心过去几个季度需求相对疲软,主要因芯片供给限制,放开H200后预计云厂商对国内数据中心需求会大大提高。股票建议上推荐两家hyper scalers和两家数据中心标的,分别是腾讯、阿里巴巴,以及GDS、Vnet。

2、云厂商芯片租赁分布特征

芯片租赁的分布情况:云厂商因GPU限制存在芯片租赁分布特征:更倾向于在海外数据中心部署训练芯片,国内数据中心租赁的芯片更多用于推理需求。其中,海外数据中心部署训练芯片,国内数据中心部署推理芯片是主要的分布差异。

3、硬件视角下的H200需求与国产芯片情况

H200需求持续性及Harper优势:H200作为已迭代结束的芯片,需求将延续至2026年上半年;Harper在国内受欢迎主要因其有较多开源生态,便于建制AI运算,且在八卡服务器中性价比非常好,呼应了H200对云厂极具吸引力的特点,即使加25%费用仍有需求存在。

国产AI芯片供给与需求展望:a. 云厂商的芯片布局:腾讯燧原、阿里平头哥、百度昆仑、ByteDance自身AC部门为云厂商芯片伙伴;b. 合规情况:2023年10月美国出口管制ECCN code 3A09类别规范芯片性能限制,低于阈值无需准证,高于则台积电不接相关生意,燧原在台积电流片为合规设计更改,不排除其他云厂商IT部门后续做低算力Inference芯片;c. 国产芯片产能与需求:中芯国际2025年月产能约8000片,2026年或到2万片,后年增长到3-4万片;2027年国产专利芯片需求约48个1.12S;d. 供给格局:未来一年进口与国产并行,因算力供给不足,两边均可成长;e. 台积电成本测算:每百万片H200的Viva front end加Cores成本约1300万美元,对应1.3亿美元营收,占台积电营收约1%,开放后对台积电的upside需结合中国政策定版情况判断。

4、下游H200相关受益公司梳理

下游受益公司分析:下游H200相关受益公司涵盖UBB、整机组装及被动元件等环节:伟创是UBB主要受益方,处于核心供应商地位;CPU motherboard市场分散,无显著受益公司;整机组装环节主要厂商位于国内,浪潮是H200组装大厂,联想供应Hopper相关系统但受益有限(总营收约60-70 billion美金,Hopper相关营收仅几百个million,占比约1%),主要受益方为浪潮及未上市组装厂;被动元件领域,日本是AI被动元件主要供应商,国巨在H200系统中有 exposure但占比10%以下;整体来看,FII和伟创是主要受惠者。

声明:本站所有文章资源内容,如无特殊说明或标注,均为采集网络资源。如若本站内容侵犯了原著者的合法权益,可联系本站删除。